AI-RAN 正在成为电信行业讨论度最高的技术主题之一。有些人把它看作无线网络演进的下一阶段,也有人认为在商业模式、成本结构和技术架构得到充分验证之前,它可能存在被过度宣传的风险。要真正理解 AI-RAN,就不能只停留在营销概念上,而需要观察无线接入网、AI 计算、芯片架构、边缘计算和 6G 战略正在如何融合。

AI-RAN 是 Artificial Intelligence Radio Access Network,即人工智能无线接入网。简单来说,它指的是将 AI 技术应用到无线接入网,或建设一种能够以更融合的方式同时处理通信负载和 AI 负载的无线接入网络。它并不只是把 AI 软件放进基站,更深层的概念是把基站从单一通信节点转变为智能边缘计算节点。

本文从方案和工程视角解释 AI-RAN,内容包括从传统 RAN 到 Open RAN 的演进,CPU、GPU、FPGA 和 ASIC 芯片的角色,AI for RAN、AI and RAN、AI on RAN 的含义,NVIDIA、SoftBank、Nokia、Ericsson、Huawei、ZTE 等企业推动的行业进展,以及运营商必须考虑的主要部署挑战。

先理解 RAN,再理解 AI-RAN

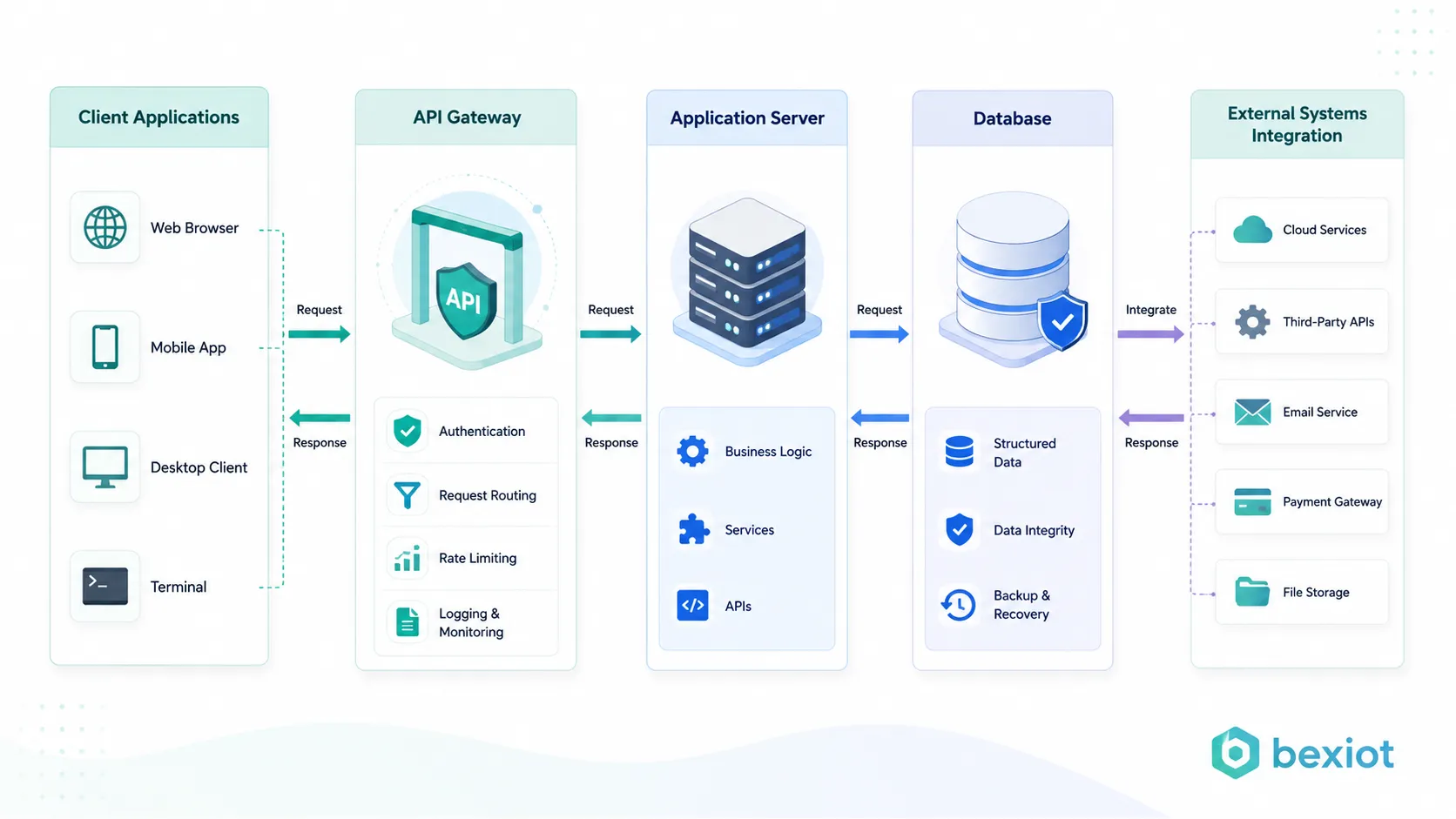

RAN 是 Radio Access Network,即无线接入网。在移动通信网络中,通常可以分为核心网、传输网和无线接入网三大部分。RAN 是连接智能手机、工业终端、传感器、车辆和 IoT 设备等用户设备与运营商网络的第一层网络。

在 4G 时代,基站通常由天线、被称为 RRU 的远端射频单元、被称为 BBU 的基带单元,以及它们之间的连接链路组成。天线和射频单元负责无线信号的发送和接收,BBU 则负责调制、解调、编码、解码、信道估计和资源调度等基带处理任务。

到了 5G 时代,架构发生变化。天线和 RRU 更深度地集成,并演进为 AAU,即有源天线单元。同时,BBU 功能被拆分为 CU 和 DU。CU,即集中单元,主要负责非实时功能;DU,即分布单元,主要负责实时基带处理。这种拆分提高了网络灵活性,但也让架构更加复杂。

为什么 RAN 很难开放和虚拟化

核心网更容易虚拟化,因为它的许多任务与路由、交换、会话控制和业务管理有关。这推动了 NFV,即网络功能虚拟化的发展。RAN 则困难得多,因为基带处理对时延、计算密度、定时精度和实时性能都有严格要求。

传统基站通常是由电信设备厂商构建的封闭系统,使用定制 ASIC 芯片和专有软件。这种“黑盒”模式效率很高,因为 ASIC 芯片专门为固定负载设计。对于 RAN 基带处理来说,ASIC 能够提供较高的计算密度、较低的功耗和稳定的时延。

后来,运营商推动行业向更开放的白盒架构发展,目标是软硬件解耦、接口标准化,并允许通用服务器和芯片承载电信工作负载。这一方向催生了 C-RAN、O-RAN、vRAN、xRAN 和 Open RAN。

从 C-RAN 到 Open RAN

在 4G 时代,中国移动推动了 C-RAN,即集中式 RAN。其思路是将多个分散部署的 BBU 转移到集中机房,构建基带池。该基带池集中处理基带负载,并通过光纤链路把信号分发到远端射频单元。

Open RAN 进一步向前发展。它的核心思想是模块化架构和标准化接口。如果接口兼容,RU、DU 和 CU 可以来自不同厂商。基带软件也可以从专用芯片中剥离出来,运行在 x86 或 ARM 等通用平台上。

然而,Open RAN 也暴露出一个重要工程问题。通用 CPU 平台虽然灵活,但与基于专用 ASIC 的系统相比,可能功耗更高、效率更低、时延稳定性更弱。这也是许多 Open RAN 部署在大规模商用中遇到困难的原因。RAN 不只是软件问题,也是实时计算和能效问题。

为什么 GPU 进入 RAN 讨论

AI-RAN 的逻辑始于芯片架构。在电信和计算系统中,主要逻辑计算芯片包括 CPU、GPU、FPGA 和 ASIC。CPU 代表通用计算,常与 Open RAN 式架构相关;ASIC 代表专用电信设备;FPGA 具备灵活性,常用于原型验证或小规模专用部署;GPU 则是推动 AI-RAN 的关键新力量。

NVIDIA 的 AI-RAN 战略建立在把 GPU 计算引入基站系统之上。其目标不仅是用 GPU 进行基带处理,还包括在网络边缘附近运行 AI 模型。如果基站能够同时处理 RAN 负载和 AI 负载,它就可能成为一种新的边缘 AI 基础设施。

这一点很重要,因为电信设备采购是一个非常大的市场,全球电信设备年支出超过 1000 亿美元。如果 GPU 成为基站架构的一部分,电信网络就可能成为一个新的大型计算市场。

AI-RAN 不只是 GPU 基站

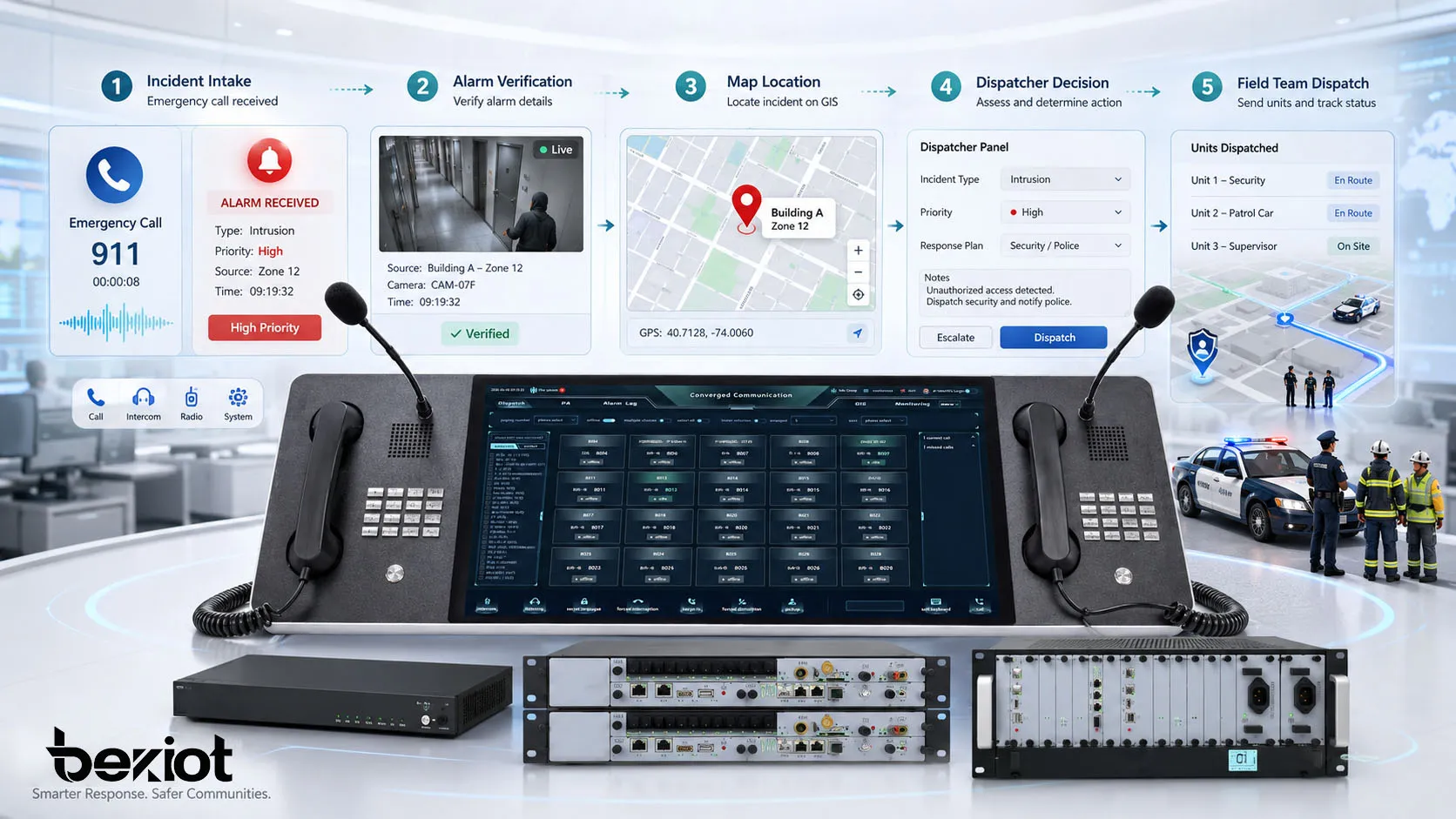

AI-RAN 最重要的想法并不是简单地“在基站里安装 GPU”。更具战略意义的想法是把基站变成一个具有 5G 和未来 6G 连接能力的低时延 AI 边缘服务器。在这种模式下,基站同时做两件事:处理无线信号,并为附近用户、设备、车辆、摄像机、机器人和工业系统运行 AI 推理。

AI 也可以改善 RAN 本身。借助 AI 算法和 GPU 加速,网络可以实现更智能的信道状态预测、动态多用户干扰识别、毫米波波束优化、流量预测、节能控制和无线资源调度。这些能力可能提升网络性能,并降低运维复杂度。

从边缘计算角度看,AI-RAN 位于云和终端之间。云数据中心计算能力最强,但距离用户远,可能带来较高时延;智能手机和 IoT 终端距离用户近,但计算能力有限;基站位于中间,比云更近,又比多数终端更强,因此天然适合承担低时延边缘 AI。

AI-RAN 的三大技术方向

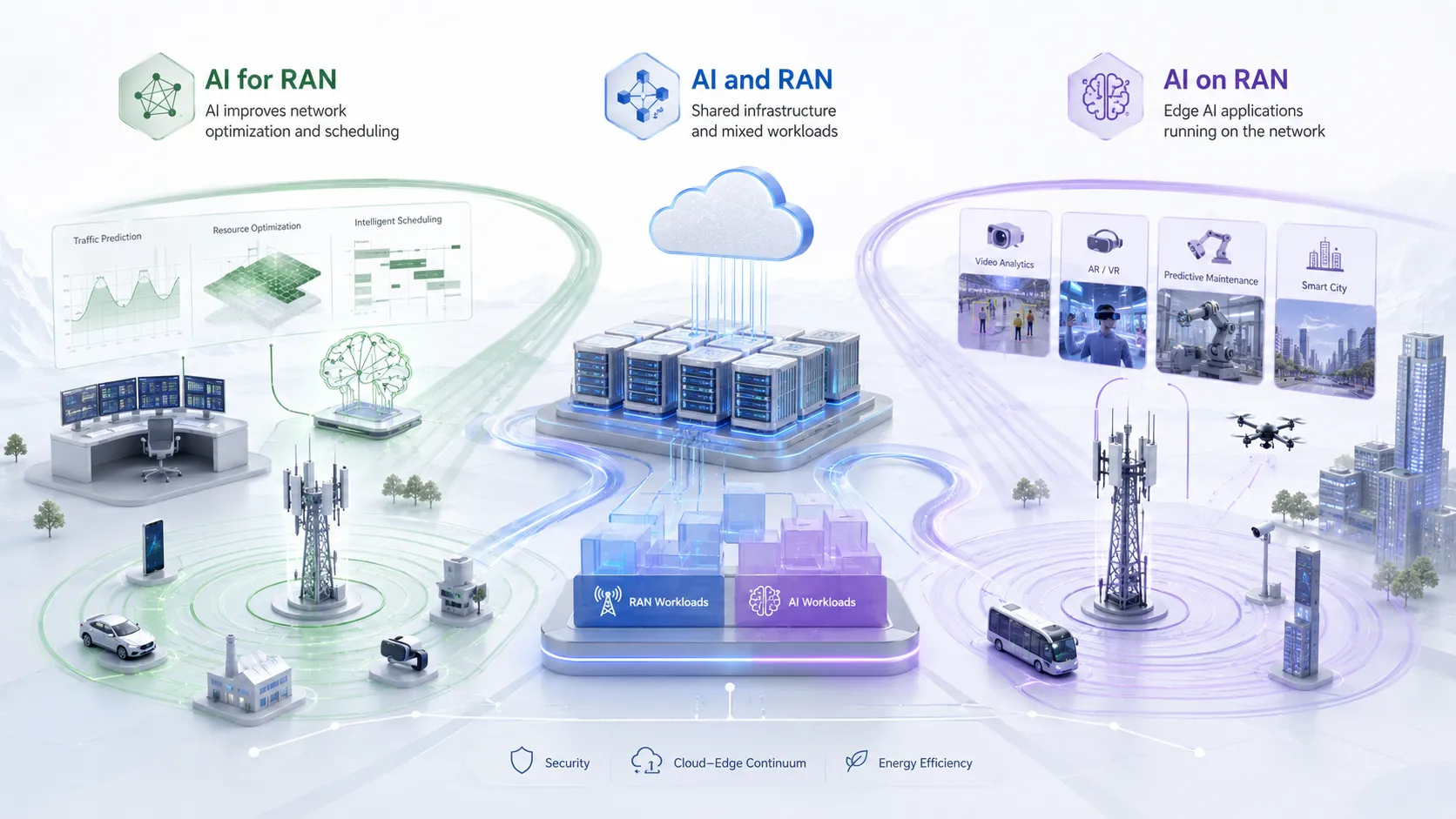

AI-RAN Alliance 将 AI-RAN 研究划分为三大方向:AI for RAN、AI and RAN 和 AI on RAN。这三个方向不同,但彼此关联。

AI for RAN

AI for RAN 指用 AI 改善无线接入网。目标是让网络更高效、更智能、更易运维。典型用例包括流量预测、智能调度、节能优化、故障检测、干扰管理和波束成形优化。

这是最直接、最现实的方向,因为它改善的是电信网络本身。运营商关注它,是因为它可能提升网络性能并降低运营成本。

AI and RAN

AI and RAN 指在同一套基础设施上运行通信功能和 AI 功能。在这种模式下,RAN 负载和 AI 负载共享计算资源。技术挑战在于如何隔离、调度、优先级排序和平衡两类负载,同时不影响实时通信性能。

这一方向很重要,因为它决定 AI-RAN 能否成为具有成本效益的平台。如果同一硬件可以同时支持网络通信和 AI 服务,运营商就可能获得更高的资源利用率。

AI on RAN

AI on RAN 指利用 RAN 基础设施支持外部 AI 应用。这是想象空间最大的方向。基站不再只是通信节点,而变成可编程的边缘智能节点,可支持视频分析、工业定位、自动驾驶系统、智慧城市应用、车联网、AR/VR 和低时延 AI 服务。

这也是 AI-RAN 与 6G 联系最紧密的地方。未来网络可能不仅传输数据,还会在边缘完成感知、计算、分析和智能协同。

AI-RAN 的行业进展

AI-RAN 从概念走向产业行动的速度很快。2024 年 2 月,在巴塞罗那世界移动通信大会上,NVIDIA、SoftBank、Ericsson、Nokia、Microsoft 等创始成员发起成立 AI-RAN Alliance。该联盟最初有 11 个创始成员,并很快扩展到 100 多家运营商、厂商和生态伙伴。

2024 年 11 月,NVIDIA 和 SoftBank 宣布试验他们称为全球首个能够同时处理 AI 和 5G 工作负载的 AI-RAN 网络。2025 年,NVIDIA 向 Nokia 投资 10 亿美元,成为其主要股东之一,并加强双方在 6G RAN 和 AI-RAN 解决方案上的合作。

NVIDIA 还持续构建全栈 AI-RAN 方案。2025 年,它推出 Aerial RAN Computer Pro,也称 ARC-Pro,以及 AI Aerial 软件平台。该方案集成 GB200、BlueField-3、Spectrum-X 网络和 CUDA-X 库等技术,用于电信级场景。

随后,NVIDIA 及其合作伙伴推广“All-American AI-RAN”技术栈,旨在为 vRAN 部署、AI 应用和 6G 研究在 GPU 内部或跨 GPU 动态分配计算资源。2026 年 3 月,NVIDIA 在 GTC 上提出 AI Grid 愿景。在该愿景中,AI-RAN 是关键的边缘网络和计算层,而 AI Grid 则提供分布式云和编排能力。

两条行业路径:加入或独立构建

电信行业对 AI-RAN 正形成两类主要回应。第一条路径是全面拥抱基于 GPU 的 AI-RAN 架构。SoftBank 和 AT&T 等运营商关注网络智能化、降低运营成本、创造新服务,以及在 6G 时代提前布局。有行业估算认为,在某些场景中,AI-RAN 式自动化和智能化可能使 OPEX 降低超过 30%。

Nokia 是这一路径中最受关注的设备厂商之一。其 anyRAN 软件可与 NVIDIA GPU AI RAN 平台集成。2026 年 3 月,Nokia 宣布与 T-Mobile US、Telkom Indonesia 和 SoftBank 等运营商进行 AI-RAN 功能测试。

第二条路径是独立探索。许多设备厂商和运营商认同 AI 将改变通信架构,但不希望深度锁定在单一 GPU 厂商生态中。例如 Ericsson 一方面在 NVIDIA AI 平台上测试 RAN 软件,另一方面也把可编程神经网络加速器集成到自研 Ericsson Silicon 芯片中,并推动 AI 推理更靠近 AAU 和 RRU 等无线侧设备。

Huawei 和 ZTE 也在探索各自的 AI 与电信融合路线。Huawei 提出了 AI-Centric Network,ZTE 则推出 AIR MAX。这些策略说明,AI-RAN 不是某一个厂商的单一方案,而是正在成为具有多条技术路线的更广泛行业方向。

为什么运营商既感兴趣又担忧

运营商对 AI-RAN 感兴趣,是因为它可能帮助他们摆脱“哑管道”困境。传统运营商往往销售连接能力,但单纯连接的价值正承受压力。如果基站能够成为可编程的 AI 边缘服务节点,运营商就可能基于低时延 AI 推理、行业应用、数据开放、专网和边缘计算服务建立新的商业模式。

一些运营商也谈到从流量运营转向“token 运营”,或从通信服务提供商转型为计算服务提供商。AI-RAN 符合这一战略目标,因为它把无线连接和边缘 AI 计算结合在一起。

不过,运营商也存在担忧。如果基带处理和 AI 推理与某一 GPU 平台深度绑定,RAN 架构的控制权可能向该厂商生态转移。这会带来供应商锁定、技术主权、供应链依赖、成本透明度和长期议价能力等方面的担忧。

AI-RAN 的部署挑战

在大规模部署成为常态之前,AI-RAN 面临多项现实挑战。第一是成本。由于 AI 加速器、服务器、网络设备和站点升级都很昂贵,CAPEX 可能很高;GPU 系统也可能消耗大量电力,并要求新的散热、维护和运营流程,因此 OPEX 也可能很高。

第二个挑战是商业模式设计。运营商必须回答一个困难问题:边缘 AI 计算如何计量、定价、销售和运营?AI-RAN 容量应像云计算资源、网络切片、行业服务,还是一种全新的服务类别来销售?

第三个挑战是标准化。电信标准通常由 3GPP 推动,而 AI-RAN 由 AI-RAN Alliance 及相关生态玩家强力推动。对于数据语义、模型接口、服务编排、负载调度和商业责任,目前仍没有完全统一的行业框架。

第四个挑战是生态成熟度。芯片厂商、电信设备厂商、运营商、云服务商、终端厂商、应用开发者和 AI 模型提供商都需要决定支持哪条技术路线。目前许多企业仍在评估是否深度投入,以及如何避免押错架构。

为什么异构计算可能是真正答案

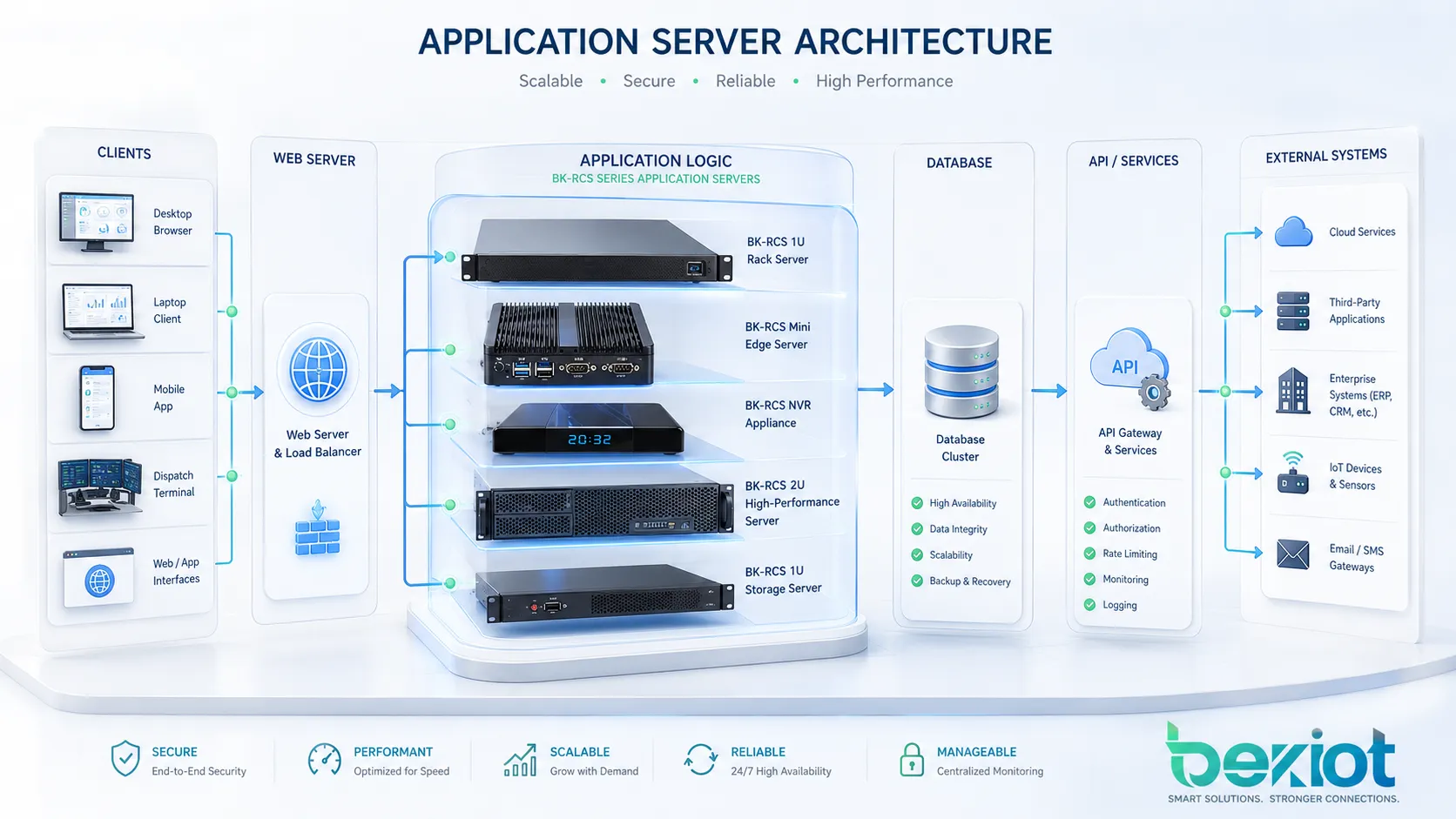

AI-RAN 很可能会继续发展,但最终的计算架构未必是纯 GPU 架构。更现实的方向是异构计算,即组合 ASIC + GPU + CPU,并在某些场景中加入 FPGA。每类芯片都有自己的角色。

ASIC 适合固定电信负载,效率高;CPU 提供灵活的通用控制和业务处理;GPU 擅长并行 AI 计算和部分加速 RAN 负载;FPGA 可在专用场景中提供可编程加速。运营商可以根据性能、效率、成本、部署规模和生态要求混合不同计算资源。

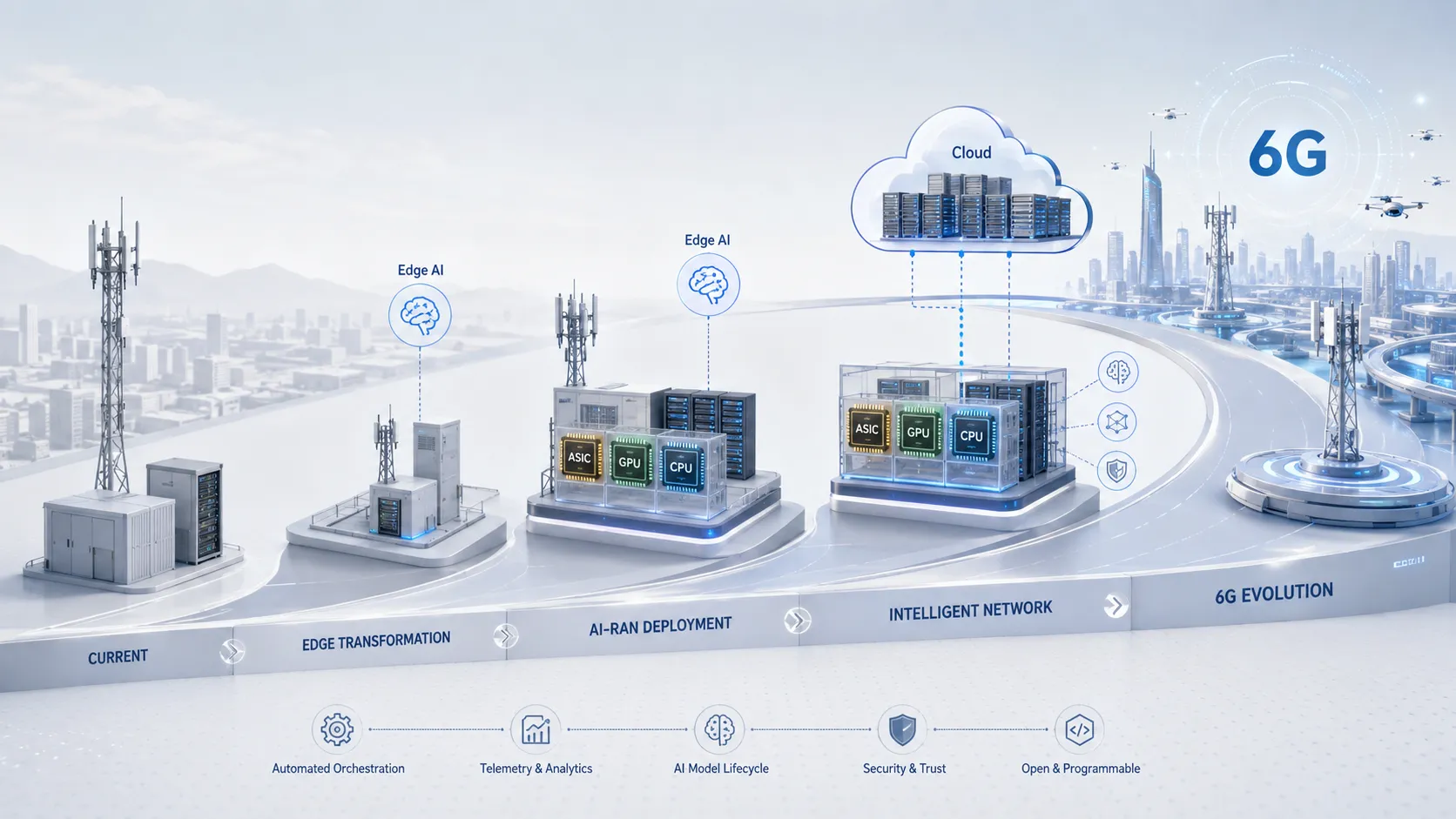

这种混合架构可以帮助运营商避免过度依赖单一技术路线,也能让 AI-RAN 从网络优化、边缘视频分析、工业定位、专网和 6G 研究平台等选定用例开始逐步部署。

推荐的 AI-RAN 方案架构

务实的 AI-RAN 方案应设计为分层架构,而不是简单的硬件升级。无线层包括 RU、AAU、DU 和 CU 功能;计算层包括 ASIC、CPU、GPU,并可能包括 FPGA 资源;AI 层包括模型运行时、推理引擎、数据处理和优化算法;编排层负责负载调度、服务开放、监控和生命周期管理。

在这种架构中,电信负载必须始终保持确定性性能。AI 负载则可根据优先级、可用容量和时延要求进行调度。例如,实时 RAN 处理应优先于非关键 AI 推理;视频分析、定位和低时延控制等工业应用应根据业务 SLA 分配资源。

运营商还应设计 AI-RAN 安全与治理层,包括数据隐私、模型安全、访问控制、审计日志、服务隔离和故障恢复。由于 AI-RAN 把网络基础设施与 AI 应用连接在一起,其安全要求可能比传统基站部署更加复杂。

AI-RAN 用例

网络优化

AI 可以预测流量模式、识别干扰、优化无线资源调度、提升节能效果,并支持自动网络调优。这主要属于 AI for RAN。

边缘视频分析

具备边缘 AI 计算能力的基站可以处理附近的视频流,用于公共安全、工业监测、交通管理和智慧园区应用,从而减少把所有数据回传到中心云的需求。

工业专网

在工厂、港口、矿山、能源场站和物流园区,AI-RAN 可以把私有 5G 连接与本地 AI 推理结合起来,支持机器视觉、机器人控制、人员安全、设备巡检和低时延生产监测。

6G 研究与 AI 原生网络

AI-RAN 可能成为 6G 的重要基础。未来网络可能融合通信、感知、计算和智能。AI-RAN 为这种 AI 原生网络架构提供了一条可能路径。

结论

AI-RAN 是电信行业最重要的技术方向之一。它连接了 RAN 演进、AI 计算、边缘基础设施、Open RAN、GPU 加速和 6G 战略。它的目标不仅是提升基站性能,更是把无线接入网转变为智能边缘计算平台。

不过,AI-RAN 仍处于早期阶段。自 2024 年 AI-RAN Alliance 成立以来,行业进展很快,但大规模商业成功尚未得到保证。高 CAPEX、高 OPEX、功耗、供应商锁定、不确定商业模式、标准化缺口和生态不成熟仍是主要挑战。

最可能的未来不是用基于 GPU 的 AI-RAN 简单替代传统 RAN,而是异构计算、分阶段部署、开放接口、商业模式验证和面向 6G 的演进。AI-RAN 可能成为下一轮电信革命的核心技术,但它仍需要时间、真实部署和商业验证。

FAQ

AI-RAN 是什么意思?

AI-RAN 是 Artificial Intelligence Radio Access Network,即人工智能无线接入网。它指的是将 AI 技术应用到无线接入网,并把无线通信负载与 AI 计算负载进行融合。

AI-RAN 只是把 GPU 放进基站吗?

不是。GPU 是当前 AI-RAN 讨论中的重要部分,但 AI-RAN 更广泛。它包括基于 AI 的网络优化、共享 AI 与 RAN 的计算基础设施,以及把 RAN 用作边缘 AI 服务平台。

AI for RAN、AI and RAN 和 AI on RAN 有什么区别?

AI for RAN 用 AI 提升网络性能和运维;AI and RAN 在共享基础设施上运行 AI 和通信负载;AI on RAN 则把 RAN 网络作为 AI 应用的边缘平台。

为什么 AI-RAN 对 6G 很重要?

6G 预计将融合通信、感知、计算和智能。AI-RAN 可能提供这种演进所需的边缘计算和 AI 原生网络基础。

AI-RAN 最大的挑战是什么?

主要挑战包括高 CAPEX、高 OPEX、功耗、供应商锁定风险、不确定的商业模式、缺乏统一标准以及生态支持尚不成熟。

AI-RAN 最可能采用什么计算架构?

最可能的是异构架构。运营商可能结合 ASIC、GPU、CPU,有时还包括 FPGA,以平衡性能、效率、成本、灵活性和生态控制。